Помните голос учителя Чарли Брауна: «Что, что, что?» Иногда мы можем слышать, как кто-то говорит, но это не всегда означает, что мы настраиваемся на него. Теперь нейробиологи определили способ обнаружения сигналов мозга, которые показывают, когда человек действительно понимает речь.

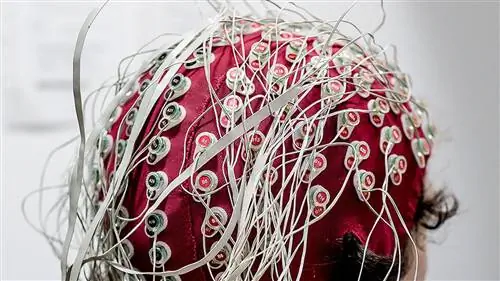

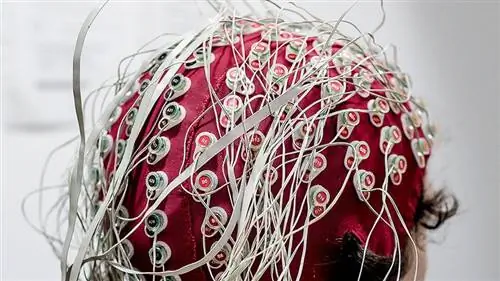

Техника, в которой применяется машинное обучение, представляет собой прогресс в использовании относительно недорогой технологии ЭЭГ (электроэнцефалография) (например, тюбетейки с проводными электродами) для мониторинга электрической активности мозга и оценки понимания. Этот подход может предложить чувствительную меру языкового развития у младенцев и понимания у пациентов, в том числе у тех, кто находится в сниженном состоянии сознания.

«Речь действительно потрясающая, но мы так привыкли к ней, а наш мозг так хорошо понимает непрерывный поток слов, что мы часто принимаем это как должное», - говорит Эдмунд Лалор, доцент кафедры биомедицинской инженерии. и неврология в Университете Рочестера и Дублинском Тринити-колледже. Лалор, руководившая исследованием, опубликованным в марте 2018 года в журнале Current Biology, отмечает, что слова слетают с языка большинства говорящих со скоростью от 120 до 200 слов в минуту. Наш мозг, когда он начеку, без особых проблем удерживает и интерпретирует звуки как слоги, слова, абзацы и значения.

Чтобы определить, сколько обработки происходит при интерпретации речи, Лалор и его коллеги, включая аспиранта и ведущего автора Майкла Бродерика, впервые применили машинное обучение к записям аудиокниг и выступлениям бывшего президента Барака Обамы, чтобы оценить ключевые моменты понимания должно произойти.«Машинное обучение привело к созданию большого длинного вектора чисел для каждого слова», - говорит Лалор. «Слово с большим числовым значением имеет большое значение и должно вызывать более сильную реакцию ЭЭГ». По его словам, показания машинного обучения совпали с показаниями ЭЭГ мозга людей, слушающих те же записи. Всплески электрического заряда мозга соответствовали ключевым моментам понимания.

Чтобы дополнительно проверить, соответствуют ли всплески электрических сигналов тому, что люди слышат, команда сняла показания ЭЭГ в других ситуациях, когда прослушивание было нарушено. В одном из них фоновый шум мешал слышать говорящего, а сигналы мозга слушателя реагировали слабее (понимание улучшалось, когда слушатель также мог видеть видео говорящего). В другом эксперименте внимание слушателя было сбито с толку конкурирующим звуком другого рассказчика, рассказывающего в то же время другую историю. «Это имитирует реальную среду, в которой вы находитесь в шумной комнате и должны сосредоточить свое внимание на одном динамике и игнорировать голоса всех остальных вокруг вас», - объясняет Бродерик. В этом шумном барном сценарии показания ЭЭГ испытуемого также показали ухудшение понимания.

Наконец, команда воспроизвела записи аудиокниг в обратном порядке. В этих тестах, говорит Бродерик, реакция мозга «исчезла», потому что звуки явно не имели смысла для слушателей.

Практика обнаружения понимания с помощью ЭЭГ не нова. С начала 1980-х годов исследователи обнаруживают всплески ЭЭГ, когда люди слышат неожиданные слова в серии. Так называемый ответ N400 обычно появляется примерно через 400 миллисекунд после того, как было услышано неконгруэнтное слово. Проблема, по словам Лалора, заключается в интерпретации значения сигнала N400.

«Вы даете людям предложение типа «дантист сказал мне почистить мое дерево», и в нем есть странное нарушение, и поэтому ваш мозг реагирует. Люди все еще спорят, что может означать этот ответ», - говорит Лалор.. «Наша отличается тем, что она построена на оценке количества значения каждого слова в контексте. Так что это может позволить нам лучше понять различные аспекты лингвистической обработки».

Хотя Лалор признает, что их модель может быть усовершенствована, он предполагает, что тесты ЭЭГ, которые намного дешевле и доступнее, чем МРТ, могут найти несколько полезных применений. Родители, которые могут быть обеспокоены развитием своего ребенка, могут запросить их для детей даже в возрасте 18 месяцев, когда начинается раннее понимание языка. По словам Лалор, на этом этапе показания ЭЭГ должны сигнализировать о некотором базовом понимании языка. Если они этого не делают, это может быть ранним признаком языковой проблемы, которая в противном случае не может быть диагностирована до более позднего возраста.

Тестирование также может предложить недорогой способ оценки состояния пациентов в кажущемся вегетативном состоянии. Лалор говорит, что это может быть так же просто, как прикрепить электроды к пациенту, заставить его слушать аудиокнигу в течение часа, а затем провести анализ. Дамиан Круз, психолог из британского Бирмингемского университета, который анализировал работу мозга у людей с нарушенным сознанием, назвал метод команды «очень многообещающим», добавив, что подобные подходы могут «предоставить семьям и лицам, осуществляющим уход, жизненно важную информацию»."

Глядя в будущее, Лалор даже предполагает разработку носимых тестов ЭЭГ, которые могли бы мгновенно считывать, скажем, солдат на поле боя или пилот в загруженном воздушном пространстве не только слышит инструкции, но и - в отличие от учеников в классе Чарли Брауна - также регистрирует их.

" Если есть сигналы," говорит он, "тогда вы знаете, что они понимают."

Интересно

Мисс Отмар - это имя учительницы Линуса ван Пелла в «Арахисах». Впервые она появилась в комиксе 5 октября 1959 года, и с самого начала Линус был в нее безмерно влюблен.